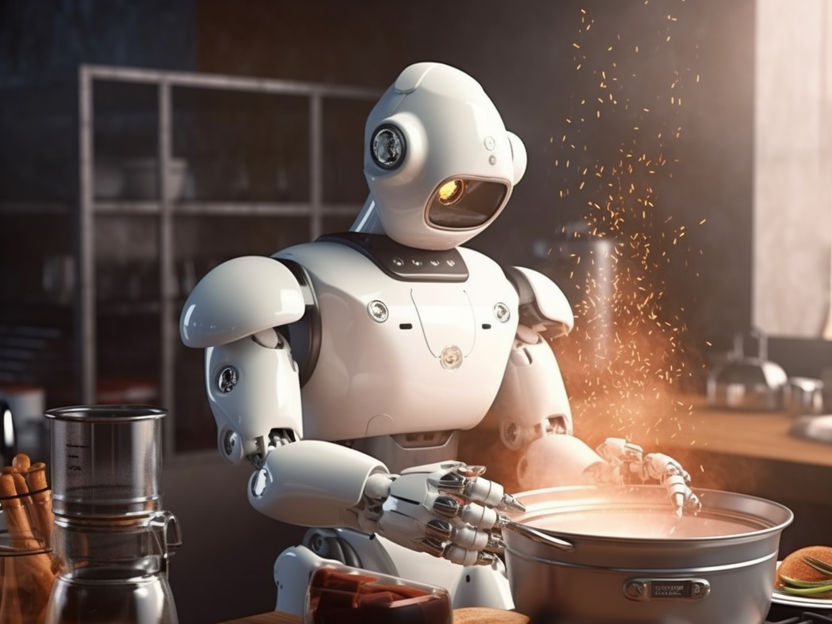

Un robot "chef" aprende a recrear recetas viendo vídeos de comida

Unos investigadores han entrenado a un "chef" robótico para que vea y aprenda de vídeos de cocina y recree el plato.

Unos investigadores han entrenado a un "chef" robótico para que vea y aprenda de vídeos de cocina y recree el plato. Los investigadores, de la Universidad de Cambridge, programaron su robot con un libro de ocho recetas sencillas de ensalada. Tras ver un vídeo de un humano haciendo una demostración de una de las recetas, el robot fue capaz de identificar qué receta se estaba preparando y elaborarla.

University of Cambridge

imagen simbólica

computer generated picture

Los investigadores, de la Universidad de Cambridge, programaron su robot con un libro de ocho recetas sencillas de ensalada. Tras ver un vídeo de un humano haciendo una demostración de una de las recetas, el robot era capaz de identificar qué receta se estaba preparando y elaborarla.

Además, los vídeos ayudaron al robot a aumentar su recetario. Al final del experimento, el robot elaboró una novena receta por sí solo. Los resultados, publicados en la revista IEEE Access, demuestran que los vídeos pueden ser una valiosa y rica fuente de datos para la producción automatizada de alimentos y podrían facilitar y abaratar el despliegue de robots cocineros.

Los robots cocineros llevan décadas apareciendo en la ciencia ficción, pero en la realidad cocinar es todo un reto para un robot. Varias empresas comerciales han construido prototipos de robots cocineros, aunque ninguno de ellos se comercializa actualmente, y están muy por detrás de sus homólogos humanos en cuanto a destreza.

Los cocineros humanos pueden aprender nuevas recetas mediante la observación, ya sea viendo cocinar a otra persona o un vídeo en YouTube, pero programar un robot para que elabore una serie de platos es costoso y requiere mucho tiempo.

"Queríamos ver si podíamos entrenar a un robot cocinero para que aprendiera de la misma forma gradual que los humanos: identificando los ingredientes y su combinación en el plato", explica Grzegorz Sochacki, del Departamento de Ingeniería de Cambridge y primer autor del artículo.

Sochacki, doctorando del Laboratorio de Robótica Bioinspirada del profesor Fumiya Iida, y sus colegas idearon ocho sencillas recetas de ensaladas y se grabaron a sí mismos haciéndolas. Después utilizaron una red neuronal de acceso público para entrenar a su robot cocinero. La red neuronal ya había sido programada para identificar diversos objetos, entre ellos las frutas y verduras utilizadas en las ocho recetas de ensalada (brócoli, zanahoria, manzana, plátano y naranja).

Utilizando técnicas de visión por ordenador, el robot analizó cada fotograma del vídeo y fue capaz de identificar los distintos objetos y características, como un cuchillo y los ingredientes, así como los brazos, las manos y la cara del demostrador humano. Tanto las recetas como los vídeos se convirtieron en vectores y el robot realizó operaciones matemáticas con los vectores para determinar la similitud entre una demostración y un vector.

Al identificar correctamente los ingredientes y las acciones del chef humano, el robot podía determinar cuál de las recetas se estaba preparando. El robot podía deducir que si el demostrador humano sostenía un cuchillo en una mano y una zanahoria en la otra, la zanahoria se trocearía.

De los 16 vídeos que vio, el robot reconoció la receta correcta el 93% de las veces, aunque sólo detectó el 83% de las acciones del chef humano. El robot también fue capaz de detectar que ligeras variaciones en una receta, como hacer una ración doble o un error humano normal, eran variaciones y no una receta nueva. El robot también reconoció correctamente la demostración de una nueva y novena ensalada, la añadió a su libro de recetas y la elaboró.

"Es increíble la cantidad de matices que el robot es capaz de detectar", afirma Sochacki. "Estas recetas no son complejas -se trata esencialmente de frutas y verduras troceadas-, pero fue realmente eficaz a la hora de reconocer, por ejemplo, que dos manzanas troceadas y dos zanahorias troceadas es la misma receta que tres manzanas troceadas y tres zanahorias troceadas".

Los vídeos utilizados para entrenar al robot chef no son como los vídeos de comida que hacen algunos influencers en las redes sociales, llenos de cortes rápidos y efectos visuales, y que pasan rápidamente de la persona que prepara la comida al plato que está preparando. Por ejemplo, al robot le costaría identificar una zanahoria si el demostrador humano la rodeara con la mano: para que el robot identificara la zanahoria, el demostrador humano tenía que levantarla para que el robot pudiera ver la verdura entera.

"A nuestro robot no le interesan los vídeos de comida que se hacen virales en las redes sociales: son demasiado difíciles de seguir", explica Sochacki. "Pero a medida que estos robots chefs mejoren y sean más rápidos identificando ingredientes en los vídeos de comida, podrían ser capaces de utilizar sitios como YouTube para aprender toda una serie de recetas".

La investigación ha sido financiada en parte por Beko plc y el Engineering and Physical Sciences Research Council (EPSRC), que forma parte del UK Research and Innovation (UKRI).

Nota: Este artículo ha sido traducido utilizando un sistema informático sin intervención humana. LUMITOS ofrece estas traducciones automáticas para presentar una gama más amplia de noticias de actualidad. Como este artículo ha sido traducido con traducción automática, es posible que contenga errores de vocabulario, sintaxis o gramática. El artículo original en Inglés se puede encontrar aquí.